SEO Beratung für News SEO und Publisher SEO. Tipps, Tricks...

WeiterlesenSEO Beratung für News Publisher

Was macht SEO für Publisher aus:

- Konzentration auf den Traffic als KPI (er finanziert Werbung, Abonnements und Reichweite).

- Notwendigkeit redaktioneller Workflows unter Einbindung der SEO

- Google News und Discover als eigenstöändige Kanäle

- Überladene Webseiten erfordern erhöhte technische SEO

- Paywalls erfordern erhöhte Aufmerksamkeit

- 2 verschiedene SEO Strategien: Evergreen vs. News-Content

- Große Contentseiten erfordern die Optimierung der internen Verlinkung bzw. der internen Struktur

- Erhöhte E-E-A-T Anforderungen: Topical Authority und Berücksichtigung der Autorensignale.

- Vermehrte Auspielung von AIOs bei informationsgetriebenen Suchanfragen

- etc.

SEO für Publisher...

… ist also etwas aufwendiger, komplexer, schnelllebigerund zumeist auch geschäftskritischer als in den meisten anderen Branchen. Es verbindet journalistische Qualität mit technischer Exzellenz und strategischer Weitsicht – und es verlangt die ständige Anpassung an einen Algorithmus, der sich selbst permanent weiterentwickelt.

SEO für Publisher – also für Verlage, Nachrichtenportale, Magazine und Content-Plattformen – unterscheidet sich in einigen wesentlichen Punkten von der SEO für andere Branchen wie etwa Ärzte oder Online-Shops. Das liegt daran, dass das Geschäftsmodell von Publishern fast ausschließlich auf organischem Traffic basiert. Während ein Arzt letztlich Patienten in seine Praxis bringen will, ist für Publisher der Traffic selbst das Produkt – er finanziert Werbung, Abonnements und Reichweite.

Hier die wichtigsten Besonderheiten:

**Content-Volumen und Geschwindigkeit:** Publisher veröffentlichen täglich Dutzende bis Hunderte Artikel. SEO muss daher in redaktionelle Workflows eingebettet sein – von der Themenfindung über die Headline-Optimierung bis zur internen Verlinkung. Es geht nicht um einzelne Landingpages, sondern um skalierbare Prozesse, die bei jedem veröffentlichten Beitrag greifen.

**Google News und Discover als eigenständige Kanäle:** Neben der klassischen Google-Suche spielen Google News und Google Discover für Publisher eine zentrale Rolle. Beide Kanäle haben eigene Anforderungen: aktuelle, originäre Berichterstattung, technisch saubere Auszeichnung, schnelle Ladezeiten und hohe E-E-A-T-Signale. Ein einzelner Artikel, der bei Google Discover ausgespielt wird, kann innerhalb von Stunden hunderttausende Besucher bringen – oder eben nicht.

**Topical Authority als langfristige Strategie:** Google bevorzugt Publisher, die ein Themengebiet umfassend und dauerhaft abdecken. Wer nur gelegentlich über ein Thema schreibt, verliert gegen Wettbewerber, die konsequent Cluster aus zusammenhängenden Artikeln aufbauen. Diese thematische Autorität entsteht durch Tiefe, Breite und konsequente interne Verlinkung innerhalb eines Themenfelds.

**Technisches SEO auf einem anderen Niveau:** Publisher-Websites sind oft komplex – mit Tausenden bis Millionen indexierten Seiten, dynamischen Kategorieseiten, Paginierung, AMP-Versionen, Paywall-Strukturen und sich ständig ändernden Inhalten. Crawl-Budget-Management wird damit zum kritischen Faktor: Google muss effizient die wichtigen Seiten finden und indexieren können, ohne sich in irrelevanten Archivseiten zu verlieren. Saubere XML-Sitemaps, durchdachte Robots-Anweisungen und eine klare URL-Struktur sind hier existenziell.

**Core Web Vitals und Seitengeschwindigkeit:** Da Publisher-Seiten oft mit Werbeanzeigen, Tracking-Skripten und eingebetteten Medien überladen sind, wird die Seitenperformance zur ständigen Herausforderung. Googles Core Web Vitals – also Ladegeschwindigkeit, Interaktivität und visuelle Stabilität – haben direkten Einfluss auf Rankings. Der ewige Konflikt: Mehr Werbung bringt kurzfristig Einnahmen, verschlechtert aber die Nutzererfahrung und damit langfristig die Sichtbarkeit.

**Paywalls und Indexierung:** Viele Publisher arbeiten mit Bezahlschranken. Google erlaubt das, verlangt aber Transparenz: Structured Data im Format „NewsArticle“ mit der Kennzeichnung „isAccessibleForFree“ sowie die korrekte Implementierung von Flexible Sampling – also eine begrenzte Anzahl frei zugänglicher Artikel für Nutzer, die über die Suche kommen. Wer das falsch umsetzt, riskiert, dass Google die Inhalte hinter der Paywall nicht mehr indexiert.

**Evergreen vs. News-Content:** Publisher müssen zwei grundlegend verschiedene SEO-Strategien parallel fahren. Nachrichteninhalte sind kurzlebig und konkurrieren um Aktualität – hier zählen Geschwindigkeit, Originalität und Sichtbarkeit in Google News. Evergreen-Inhalte wie Ratgeber, Erklärstücke oder Hintergrundberichte hingegen sollen über Monate und Jahre organischen Traffic liefern und müssen regelmäßig aktualisiert werden, um relevant zu bleiben.

**Structured Data in großem Umfang:** Publisher nutzen Schema-Markup intensiver als die meisten anderen Branchen: „NewsArticle“, „Article“, „BreadcrumbList“, „FAQPage“, „VideoObject“, „LiveBlogPosting“ und mehr. Diese strukturierten Daten ermöglichen Rich Snippets, Karussell-Einträge in Google News und eine bessere Darstellung in den Suchergebnissen. Bei Tausenden Artikeln muss die Auszeichnung automatisiert und fehlerfrei im CMS verankert sein.

**Kanonisierung und Duplicate Content:** Publisher haben ein chronisches Duplicate-Content-Problem. Syndizierte Inhalte, Agenturmeldungen, regionale Varianten eines Artikels, Druckversionen und Kategorie-Übersichtsseiten erzeugen Duplikate. Saubere Canonical-Tags und eine klare Strategie, welche Version indexiert werden soll, sind unerlässlich.

**Interne Verlinkung als Währung:** Bei Websites mit riesigen Inhaltsmengen ist die interne Verlinkung eines der mächtigsten SEO-Instrumente. Sie steuert, wie Linkautorität innerhalb der Seite verteilt wird, welche Themencluster gestärkt werden und welche Artikel von Google priorisiert werden. Viele große Publisher setzen automatisierte interne Verlinkungssysteme ein, die kontextbasiert relevante Artikel verknüpfen.

**Autorensignale und Bylines:** Google achtet bei Publisher-Inhalten verstärkt auf erkennbare Autorenschaft. Klare Bylines, verlinkte Autorenprofile mit Biografie und Expertise sowie konsistente Namensnennung stärken die E-E-A-T-Signale. Anonyme oder unter Pseudonym veröffentlichte Inhalte werden tendenziell schwächer bewertet.

**Konkurrenz um Featured Snippets und SERP-Präsenz:** Publisher konkurrieren nicht nur um die zehn blauen Links, sondern um Featured Snippets, „People Also Ask“-Boxen, Top Stories, Knowledge Panels und Video-Karussells. Jedes dieser SERP-Elemente erfordert eigene Optimierungsstrategien – von der Strukturierung der Inhalte in beantwortbaren Absätzen bis zur Videoeinbettung mit korrektem Markup.

**Abhängigkeit und Verwundbarkeit:** Die vielleicht wichtigste Besonderheit ist das Risiko. Publisher sind in einem Maß von Google abhängig, das für andere Branchen kaum vorstellbar ist. Ein einziges Core Update kann den organischen Traffic um 30, 50 oder 70 Prozent einbrechen lassen – mit unmittelbaren Auswirkungen auf Werbeeinnahmen und damit auf Arbeitsplätze. Diese Verwundbarkeit macht SEO für Publisher nicht zu einer Marketingdisziplin, sondern zu einer existenziellen Unternehmensfunktion.

Zusammengefasst: SEO für Publisher ist komplexer, schnelllebiger und geschäftskritischer als in den meisten anderen Branchen. Es verbindet journalistische Qualität mit technischer Exzellenz und strategischer Weitsicht – und es verlangt die ständige Anpassung an einen Algorithmus, der sich selbst permanent weiterentwickelt.

Der Vertrag

kkjkjhkjhkjkjjhj djf fjsd flf ödsjfsd lfj lfj fldsfljfds flsdj földjfdslf djöflsdj fösdljf sdölfsd ölfsd flösdjfsdölfjds ölfdsj flj följs öflsdjf ösdlfj sdöfjd flj följsd öflsdj flsdjf döslfj ölfjsd földj fsdlöfj sdölfjd fölsdj flösdjf sdölfjsd ölfsdjf ölsdjf sdölfjsd ölfjds földjfdlösfj öfsdljfösdlfj dsölf fölsd ölfjsdöfljsdfö dsljf ölsdjfösdljf öljdsöflj ölsdjölj ösljösldj öljf södljföljsdölfj ösdljfölj ösdljf ölj dsölfj ölsdjf ölsdjflösdjfölsdjfö lsdjföljs df

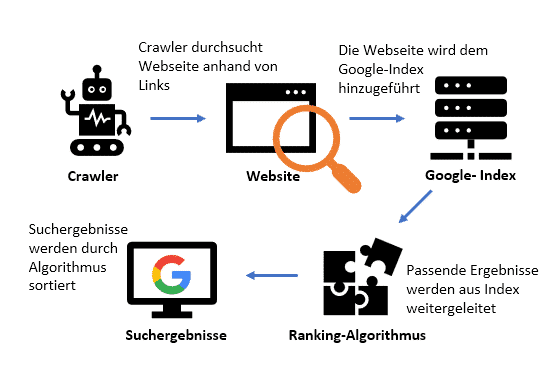

Grundlage der technischen SEO ist die Gewährleistung der Crawlbarkeit der URLs durch den Googlebot

CRAWLING & INDEXIERUNG

Die Crawlbarkeit und Indexierbarkeit ist für jede Website absolut fundamental:

Ohne die Crawlbarkeit ist es den Suchmaschinen (und damit auch den Usern) nicht möglich die Seite zu finden. Durch die Crawlbarkeit wird der Zugang des Suchmaschinen- Crawlers bzw. Googlebots erst zur Website ermöglicht. Das klingt einfach, ist es meist auch und trotzdem passieren hier oft die größten Fehler, die sofort schwerwiegende Auswirkungen haben.

Bei der Crawlbarkeitsanalyse in der technischen SEO werden hier also die Angaben der robots.txt analysiert. Wichtige Dateien dürfen nicht durch die robots.txt ausgeschlossen werden, unwichtige können dies aber gerne (mit Einschränkungen…)

Weiterhin spielen die Status Codes der einzelnen URLs eine Rolle. Es wird also untersucht, ob alle wichtige Dateien überhaupt erreichbar sind, oder auch ob zu viele 404-Fehler die Usability der Website negativ beeinflusst (und damit auch das Ranking).

Das Crawlen der Website durch den Googlebot wird durch die Bereitstellung von XML-Sitemaps oft wesentlich vereinfacht. Hier sollten wirklich alle wichtigen Dateien hinterlegt sein. Durch die XML-Sitemap werden so auch Seiten gefunden, die schlecht oder gar nicht verlinkt sind. Unwichtige Dateien sollten hier nicht auftauchen. Alle Sitemaps sollten auch bei Google in der Search Console hinterlegt werden.

Bei großen Websites spielt auch das Crawlbudget eine Rolle – denn dies ist begrenzt. Um sicherzustellen, dass alle wichtigen Seiten auch im Index landen, muss hier dann optimiert werden

Crawling durch den Googlebot

Nach dem Crawl kommt die Indexierung

Indexierung ist der nächste Schritt nach dem Crawlen. Während dieses Prozesses speichert die Suchmaschine die Informationen, die beim Crawlen gesammelt wurden, in einer großen Datenbank – dem Index. Diese Datenbank enthält eine strukturierte Sammlung von Informationen über alle gecrawlten Seiten, die es der Suchmaschine ermöglicht, schnell relevante Ergebnisse auf Nutzeranfragen zu liefern. Es gilt also, die Informationen so darzustellen, dass sie hier schnell und richtig aufgenommen werden bzw. die Einordnung und Relevanzbeurteilung seitens Google & Co.zu erleichtert werden.

Crawling und Indexierung sind also entscheidend für die Funktionsweise von Suchmaschinen. Ohne diese Prozesse könnten sie keine umfassenden und relevanten Suchergebnisse liefern.

Indexierung

„Gecrawlt ist noch lange nicht indexiert“

Altes SEO Sprichwort

Build your body by unleashing you

Suspendisse potenti nunc feugiat mi a tellus consequat imperdiet vestibulum sapien proin quam etiam ultrices suspendisse in justo eu magna luctus.

Ausführliche Veröffentlichung von Google zum Crawl Budget